تويتر هو آخر منصة تقوم بحظر هذا النوع الجديد من الفيديوهات الإباحية ”المزيفة“ التي تسمى بالإنجليزية Deepfakes؛ والتي يتم فيها استبدال الوجوه الحقيقية للممثلين بوجوه أخرى، تستهدف هذه الفيديوهات النساء المشاهير والممثلات والمغنيات بشكل عام.

وعلى عكس مواقع التواصل الاجتماعي الأخرى، يسمح تويتر بالأفلام الإباحية على مِنَصَّتِهِ، ولكن حسب التصريحات فإن هذا النوع من الأفلام الإباحية يخترق القوانين الخاصة بالموقع لاعتباره نشر محتوى خاص بدون الحصول على الموافقة على ذلك.

جاء هذا كرد فعل من قبل الشركة (التي مقرها في سان فرانسيسكو) بعد نشر اسم حساب من موقع تويتر على منتديات (Reddit) والذي خُصّص لنشر فيديوهات إباحية مزورة، حيث كان الموقع الإخباري Motherboard أول من نشر تصريحاً رسمياً صادر عن تويتر بخصوص هذا الموضوع ”سنوقف أي حساب يتضح بأنه الناشر الأصلي لمحتوى خاص تم انتاجه أو نشره من دون الحصول على الموافقة عليه“، وأضاف بأن الـDeepfakes هي بالتأكيد من الفيديوهات الممنوعة بحسب سياسات تويتر.

تبع ذلك إعلان موقع (Pornhub) بأنه سيقوم أيضاً بحذف أي فيديو من هذا النوع فور التعرف عليه، وحتى الآن، يعتبر هذا الموقع والذي يحتوي على محتوى للبالغين من أشهر المواقع في هذا المجال، وهو مازال يحتوي أيضاً على العديد من الـDeepfakes والتي تجذب عشرات الآلاف من المشاهدات.

قامت أيضاً خدمة الاستضافة للفيديو Gfycat وخدمة المحادثة Discord باتخاذ قرارات مماثلة أيضاً.

برنامج بسيط

يتم انتاج هذه الفيديوهات عن طريق استخدام برامج ذكاء اصطناعي لانتاج نسخة معدلة حاسوبياً من فيلم إباحي ولكن بوجه شخصية مشهورة أخرى، وتكون تعابير وجه الشخصية المستهدفة مطابقة تماماً للممثل الأصلي في الفيديو. وللقيام بذلك، تتطلب خوارزمية عمل البرنامج وجود العديد من الصور للشخص المستهدف مأخوذة من عدة زوايا، وفي حال كان الشخصين لهما جسدان متقاربان ستكون النتائج مقبولة جداً.

بدأ استخدام هذه التقنيات عام 2017، ولكنها أصبحت أكثر انتشاراً في الشهر الأول من عام 2018 وذلك بعد طرح برنامج (FakeApp) وهو أداة تقوم بأتمتة العملية (أي تنفذها بشكل أوتوماتيكي وبسيط)، حيث أنه لا يحتاج لأكثر من كبسة زر بعد تزويد المواد اللازمة.

هناك مجموعة على Reddit مخصصة لنشر مقاطع فيديو وآراء عن هذه العملية تمتلك الآن أكثر من 91,000 مشترك.

الإساءة للطفولة

ليست كل الفيديوهات المنتجة إباحية بالضرورة فالعديد منها يستهدف السخرية من الرئيس الأمريكي دونالد ترامب في حين تخصص مستخدم واحد للبرنامج بوضع وجه زوجة ترامب في لقطات من أفلام ديزني.

في حين أن غالبية تلك الفيديوهات تستهدف المشاهير، يوجد بعض المستخدمين الذين أصبحوا يستهدفون شخصيات مشهورة على YouTube مؤخراً، الأمر الذي أثار الجدل بين المتابعين.

بالإضافة إلى ذلك، انتشرت تقارير توثق قيام بعض الأشخاص بانتاج محتوى غير قانوني مسيء للأطفال عن طريق استخدام صور لشخصيات تحت السن القانوني (16 عاماً) وتسبب هذا الأمر بردة فعل عنيفة، التعليق التالي من أحد أعضاء منتديات Reddit ”رأيت فيديو لفتاة من أحد العروض التلفزيونية وقلت للناشر الأصلي بأن يزيله على الفور“.

ويتم تحذير المستخدمين بشكل دائم بعدم شراء أو بيع هذا النوع من الفيديوهات، حيث صرح موقع Motherboard بأن أي عمل تجاري لتلك الأفلام سيؤدي بالمتورطين به إلى المحاكمة.

أكثر واقعية

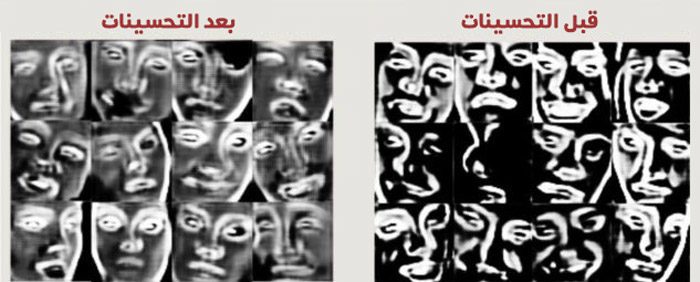

بعض المقاطع التي يتم صناعتها الآن هي ذات جودة تنافس جودة تلك المؤثرات الخاصة المستخدمة في الأفلام لتبديل وجوه الشخصيات ومن ضمنها فيلم Rougue وBlade Runner 2049، وماتزال محاولات تطويرها مستمرة.

وعلى موقع مشاركة الأكواد البرمجية Github، نشر حساب أن العمل جاري لجعل حركة بؤبؤ العين أكثر واقعية وتتبع حركات العين للشخص الأصلي في الفيديو، وهناك بالإضافة لما سبق محاولات عديدة لتحقيق تحسينات أخرى:

- تجنب عدم الوضوح في بعض الفيديوهات (jittering).

- منع الفروقات التي تحصل عندما يقوم الكمبيوتر بدمج الوجه مع الجسم الأصلي.

- انتاج درجات لونية للجسم أكثر واقعية.

ويحاول بعض الأشخاص استخدام خدمة الويب لموقع Amazon ومنصة Google Cloud كبدائل لمحاولة انتاج الفيديوهات على المخدمات الخاصة بتلك الشركات، وذلك يساعد على انتاج الفيديوهات -والتي تتطلب قوة معالجة كبيرة- بشكل أسرع من دون الانتظار لأيام، ولكن في المقابل عليهم الدفع لتلك الخدمات مقابل تزويدهم بامكانية المعالجة لديها.